對於混合實境(Mixed Reality,MR)三項期許:「從屏看穿」、「情境感知」與「智能物件」

對於混合實境(Mixed Reality,MR)三項期許:「從屏看穿」、「情境感知」與「智能物件」

作者:塾長 日期:2024-03-24 16:44

去年底第一次玩到Meta Quest 3體驗頭盔式的混合實境(Mixed Reality,MR),就對那種「雙腳跨在安全邊界兩端,螢幕中一下出現真實世界,一下又展現虛擬世界」的樣子感到驚艷,我還刻意地讓頭移來移去,看看畫面的反應有多即時!接著Apple Vision Pro也登場,強調「空間運算」(Spatial Computing),我的解讀,還是以混合實境來看。

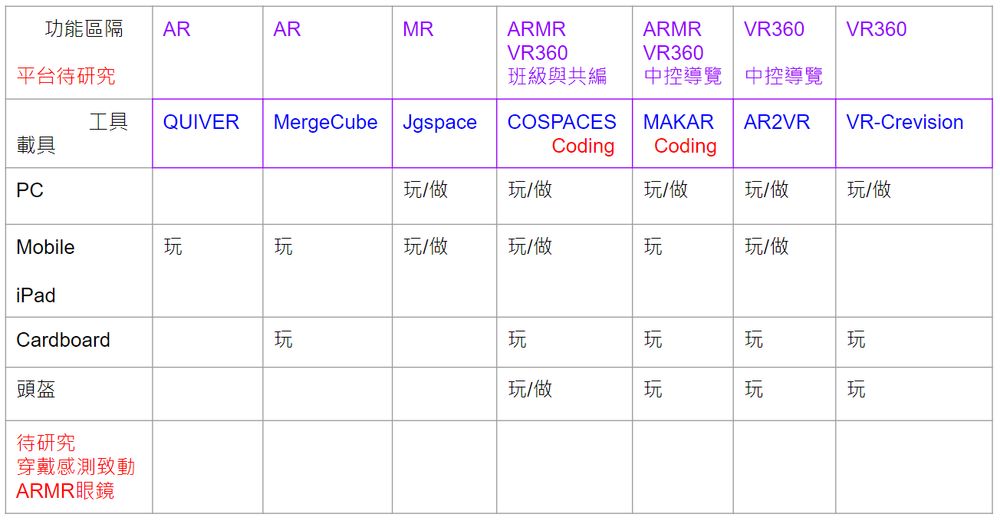

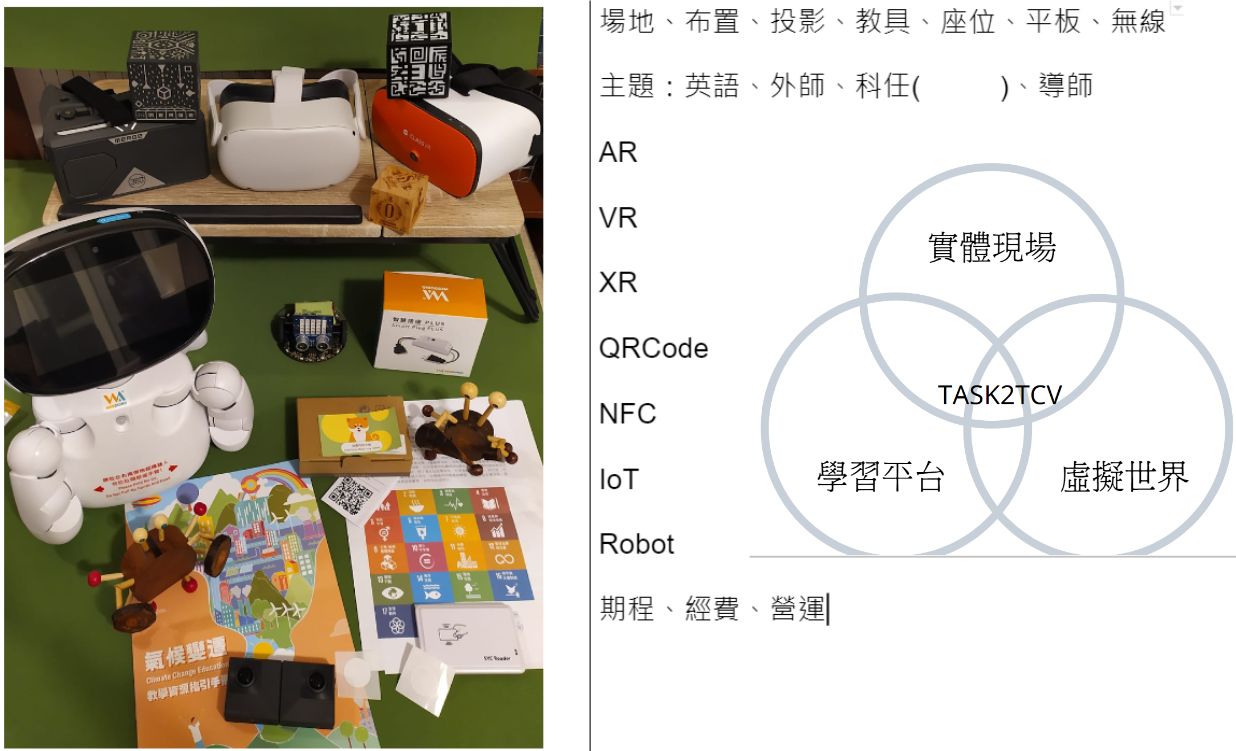

以往玩過的MR,主要利用平板,有MAKAR、Jigspace與COSPACES,而現在帶著頭盔,透過鏡頭拍攝實境展現於屏中,又有什麼期待與想望呢?先整理兩家的開發者網站裡提到的功能概念:

Meta Quest 3:Passthrough(直通、看穿)、Scene Understanding(場景理解)、Spatial Anchors(現實空間中錨定虛擬物件)。

Apple Vision Pro訴求A spectrum of immersion(沉浸式體驗光譜),包含:Windows(視窗)、Volumes (App有3D深度)、Spaces(分享的多空間)。

|  |

綜合起來,加上相關科技組合,我對這樣混合實境~原元宇宙流暢交融,有三個期許,也是自己未來想著力研究的方向:

※「從屏看穿」

硬體配備了鏡頭與感測器,可以從屏中看到眼前現場,再以應用軟體疊加資訊,就可以適時展現兼具AR、VR的應用,我們常說「沉浸式體驗」,現在本身在場的實境,現在可以創造出「再沉浸」的機會。

這樣「從屏中看到眼前現場」的樣態,某種程度增加了「安全、放心」:戴著頭盔還是看得見大家,走動也清楚現場環境。我上次戴頭盔查手機上的簡訊回應,再輸入頭盔裡的視窗,感覺很流暢方便呢!

軟硬體有了這樣的「看穿力」,我開始期待「情境感知」與「智能物件」:

※「情境感知」

我常說「實境即為寶」:獨一無二的真實現場,從教室、圖書館到各種資源中心,現場的布置規劃就很豐富,從AR、QRCode的應用疊加數位資訊,現在帶著MR頭盔,可創造另一番景象。

實體現場包含空間動線擺設,也還有像平板、大屏的數位螢幕,這些都能讓當事人、在場即時參與互動(包含遠距同步互動),環境裡或在場人還能添加各式感測器,即時創造現有環境當下的最豐富學習支持,當然,使用者的手勢姿勢含語音互動,也有完整的行為互動(任務、思考)數據紀錄。

※「智能物件」

這是依教學需要,可移動、自由擺放的實、虛物件,實體物品、海報、卡牌與書本等,在MR中添加也賦予數位互動表現,虛擬物件,從現有工具模型匯入,或者遠距協作支持、AIGC動態生成皆可期。

物件(O)也和環境(E)、參與者(P)之間發生互動,而且,這樣的O、E、P還可有實體、虛擬兩類,相信玩起來就更精采了!

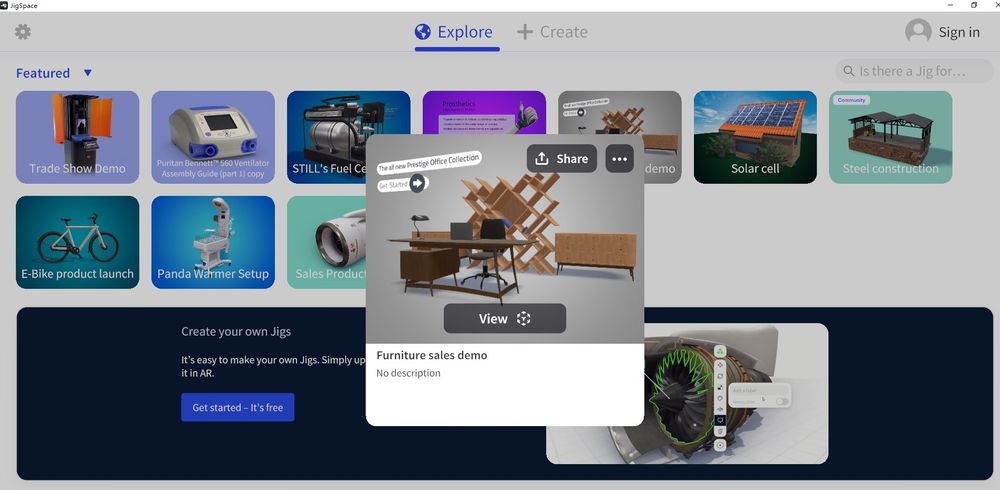

目前我玩了Figmin,得以印證上述的想法,看到Jigspace也納在Apple Vision Pro中,我對於Authoring Tool如MAKAR,則期待可以創新「戴頭盔走在空間中,既能體驗,也能即時創作、造境」等功能,開心開心!

這篇也值得參考:Charting the Future of Virtual Reality with Meta Quest 3

「日本XR、元宇宙展」簡報分享

「日本XR、元宇宙展」簡報分享

作者:塾長 日期:2024-02-18 19:44

在出發前先分享前案「日本XR、元宇宙展」簡報分享。

|  |

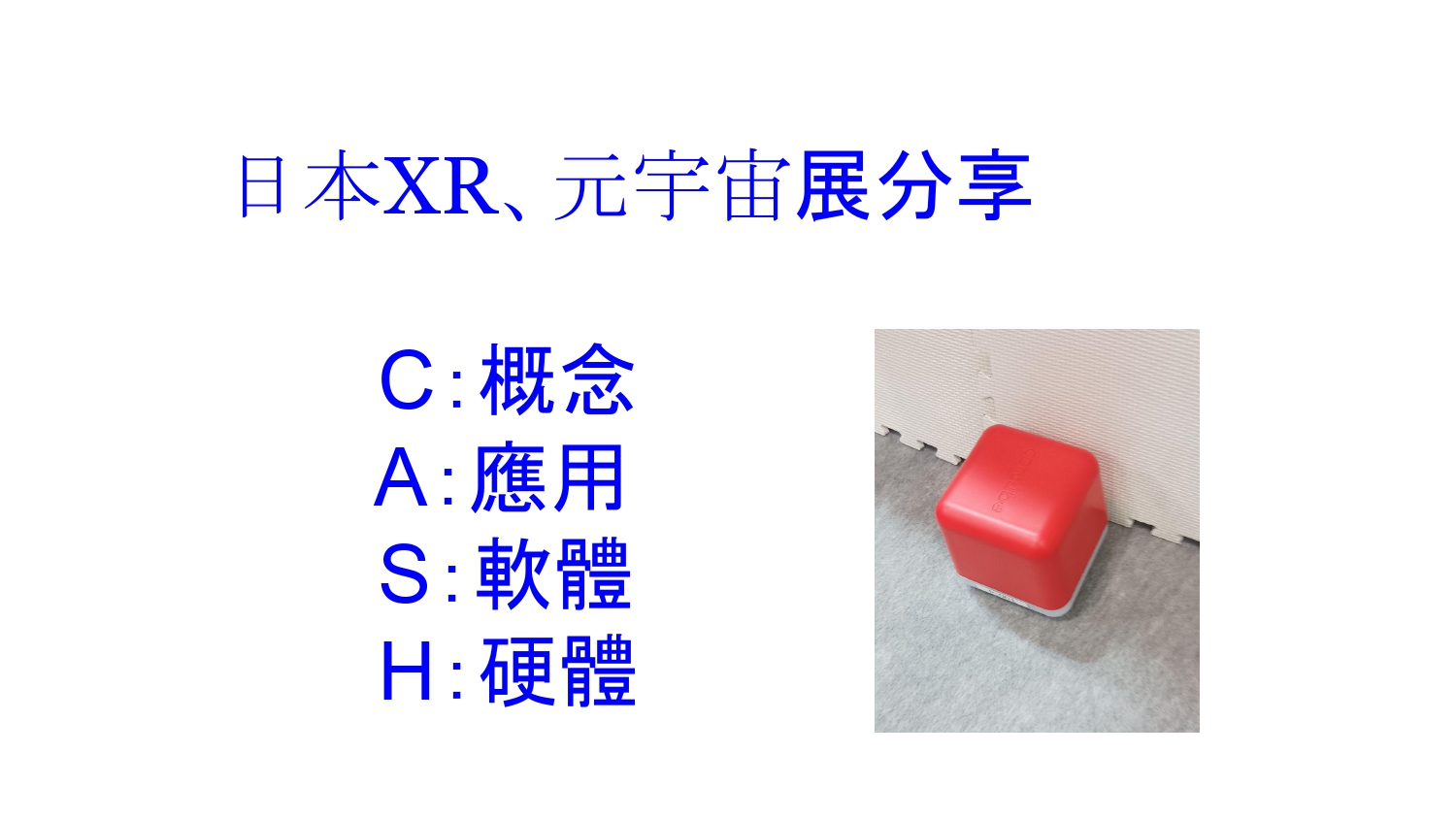

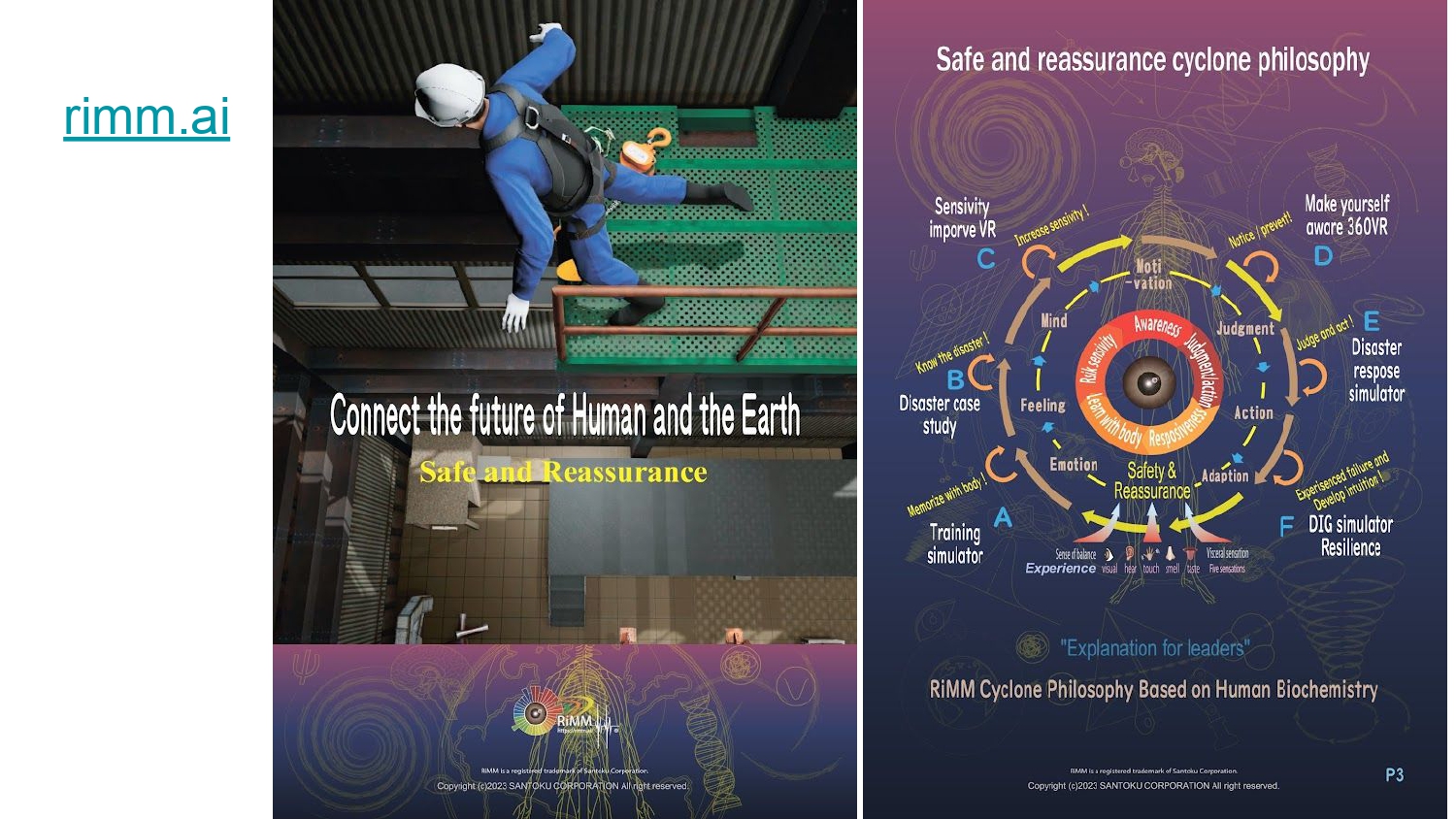

這份是去年六月底逛完日本XR第三屆、元宇宙第一屆展後製作的分享簡報,也是那時讓我覺得可以開始謀劃國家層級教育元宇宙初探~觀日本「XR、元宇宙企業 展品與服務」。

我以CASH框架來看,C:概念A:應用S:軟體H:硬體,簡報切入點,主要著重從硬體切入,一來當時國內5G新興科技計畫,正開使採買VR設備,我整理 在展裡看到精采多樣的相關周邊,也為台灣堆動新興科技導入提供發想與建言。

|  |

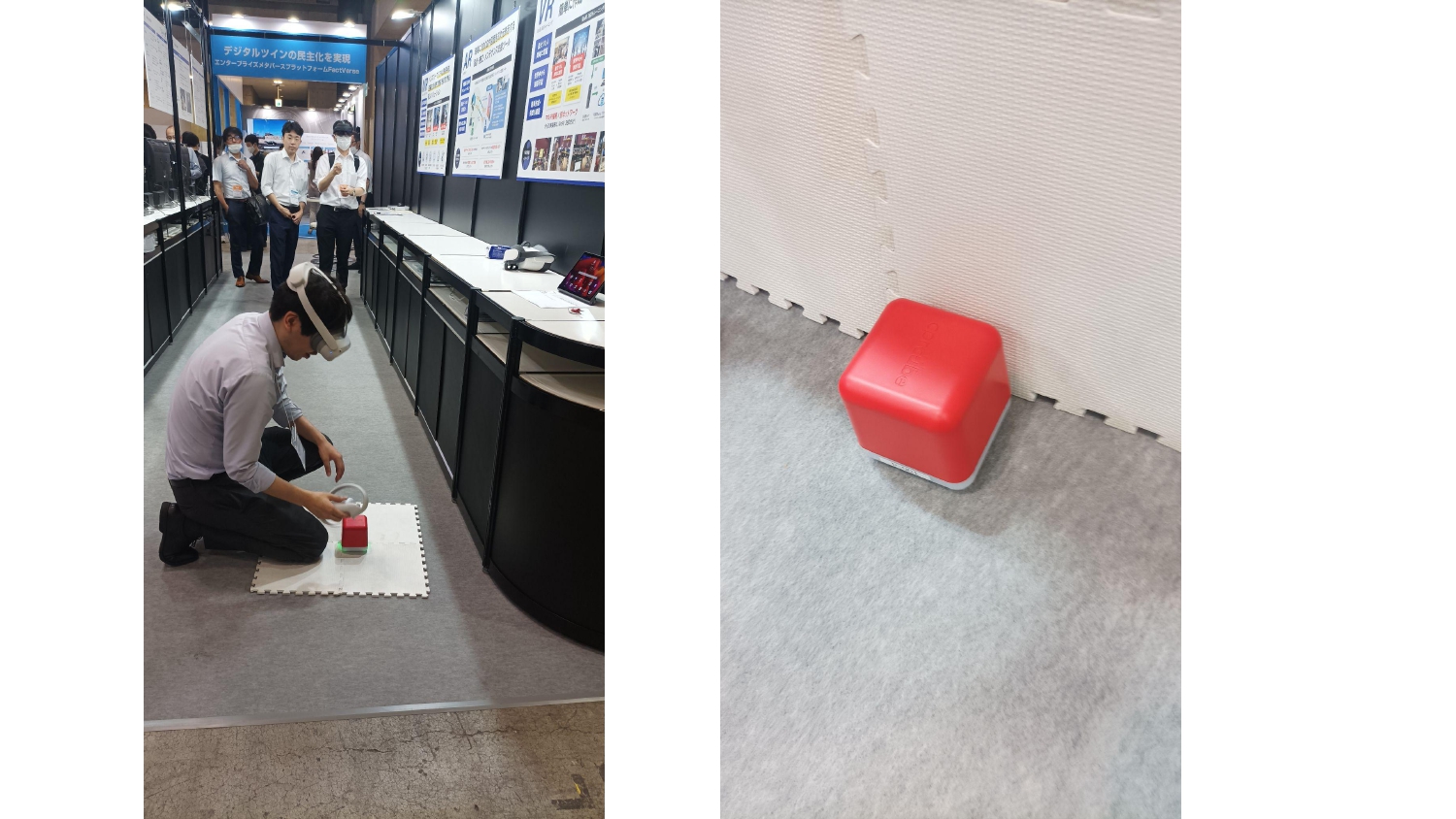

舉例看這個小小紅色軟塑膠具有彈性的方塊....它是VR裡的CPR設備喔~當時的感覺是既酷且實用呢!哈哈~

|  |

2024,日本即將啟動Next GIGA計畫,相信對於AI、元宇宙應用,再有新高度的願景與擴散,我也努力好好學思疑問探。

利用Google Slide 與IoT跨載具串玩COSPACES元宇宙

利用Google Slide 與IoT跨載具串玩COSPACES元宇宙

作者:塾長 日期:2024-02-15 09:36

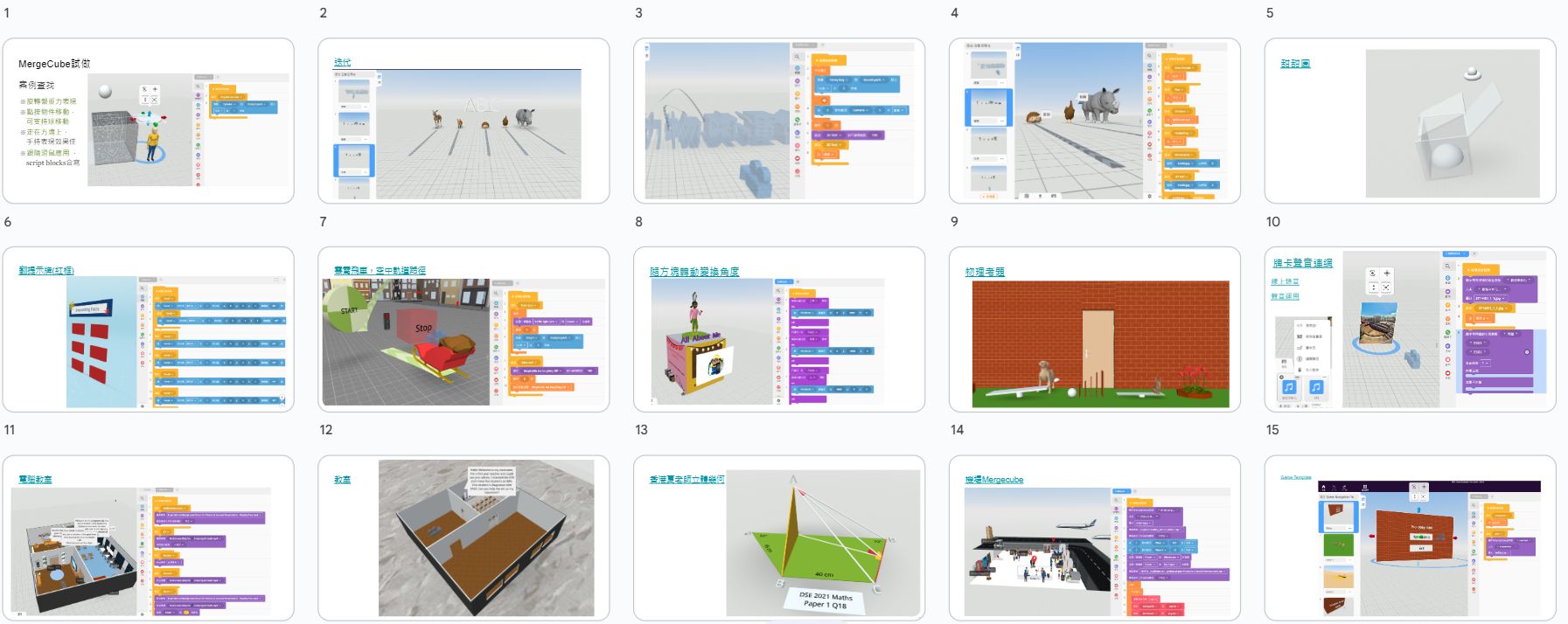

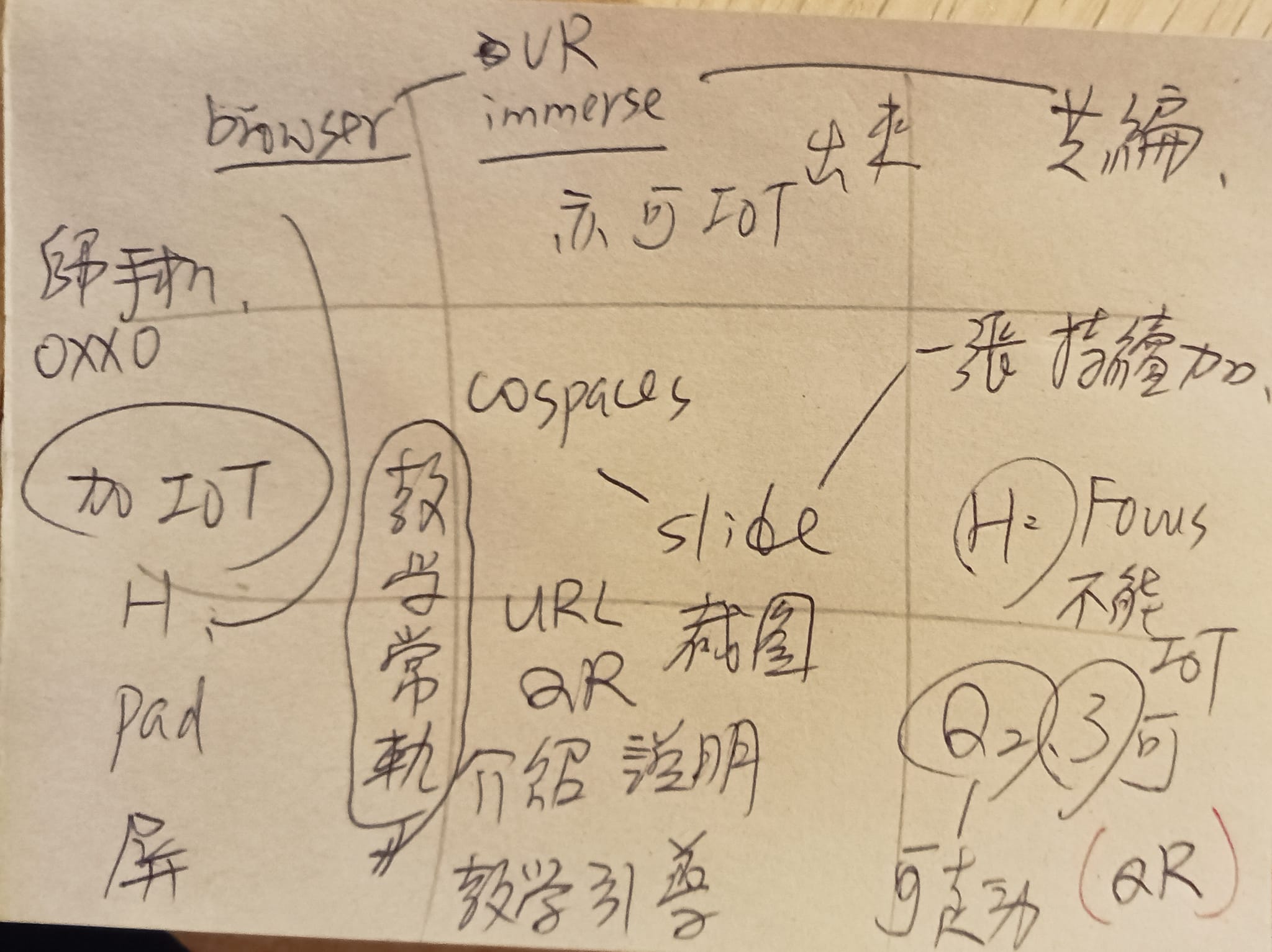

我們可以利用Google簡報整理教育大市集裡的VR作品、COSPACES連結,每頁簡報可包含軟體畫面截圖、程式解說、簡單操作引導與學習探索任務說明,也可以加上QRCode,還能視需要與其他教學活動、後續活動開展都串連起來。

這是從教學常軌經營的角度來思考:教室現場有大屏、平板,以及電腦教室,再加上虛擬實境的頭盔,利用Google簡報各頁面,就能串起跨載具間同步推進教學活動。

還可以進一步加上物聯網運用,由老師的手機來遙控所有載具的簡報播放同一頁面,又能保留當事人自由瀏覽簡報的機會,這樣不僅確保教師主導推進活動,也創造學生和同儕間自主、協作探究的機會。

此外,在VR頭盔裡,以COSPACES而言,瀏覽器是以視窗方框呈現,跨載具之間可以多人共編虛擬世界。而開啟播放檢視之後,就呈現360沉浸的樣態。

|  |

目前,三款頭盔都可利用瀏覽器看簡報、切換頁面,也能進行COSPACES編輯,而在VR360瀏覽時:

Quest2,可以用手把點選互動、走動、切換場景

Focus3,可以用手把點選互動、切換場景、但無法走動

Quest3,目前手把功能尚無法表現,不過,對於其MR功能,希望未來也能讀取QRCode和MergeCube。

此外,若以IoT控制來看,則是Quest2、3皆可IoT接收與發送訊息,而Focus3尚無法表現。

這樣形同一種「教學經營跨載具中控」的設計,還有個優勢就是google簡報的超連結不變,提供QRCode給平板掃描、頭盔利用短網址輸入即可。而簡報內頁,可以視需要添加與調整,只要指定頁碼可以共同表現即可。

ePBL科技工具混搭百玩

ePBL科技工具混搭百玩

作者:塾長 日期:2024-02-05 16:30

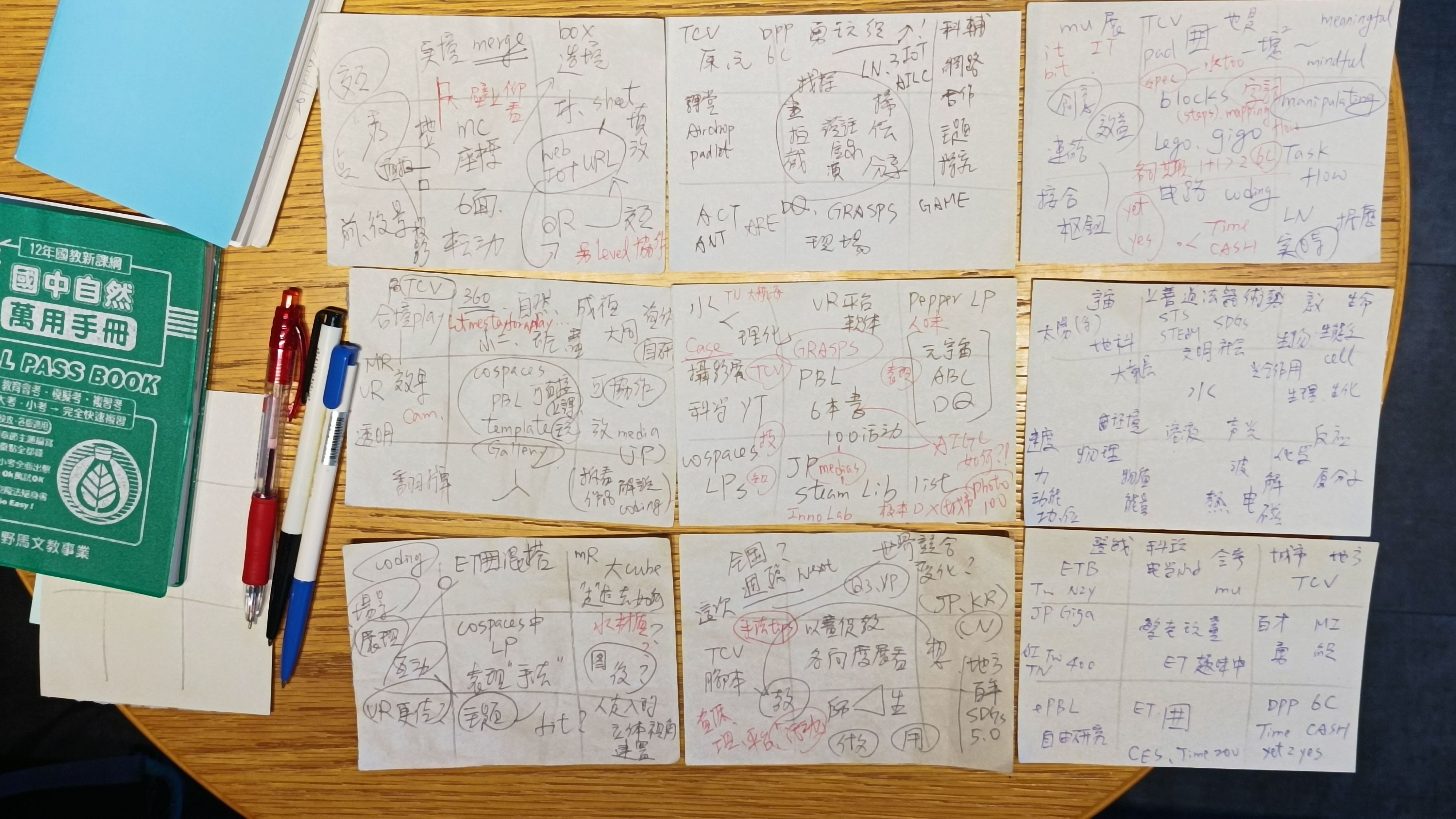

早上九張memo裡,其中的ET工具就是藉由科技支持ePBL(科技輔助網路合作主題探究)。

從上述學習表現和主題活動的結合發想後,選擇合適的科技工具、資源與平台,支持老師有效地備課與實施經營,同時讓學習者主體能有超越個人、超越現實跟超越未來的機會,投入自己心智能量、熱情地凝聚自己漸趨擅長、專業,能勇敢地來創造與實踐,同時達致領域議題的學習目標以及數位素養。對於「超越個人、超越現實跟超越未來」的科技優勢,我首選多為Web瀏覽器可用:

因為超連結,所以超個人

因為超喜歡,就能超現實

因為超期待,一起超未來、織幸福

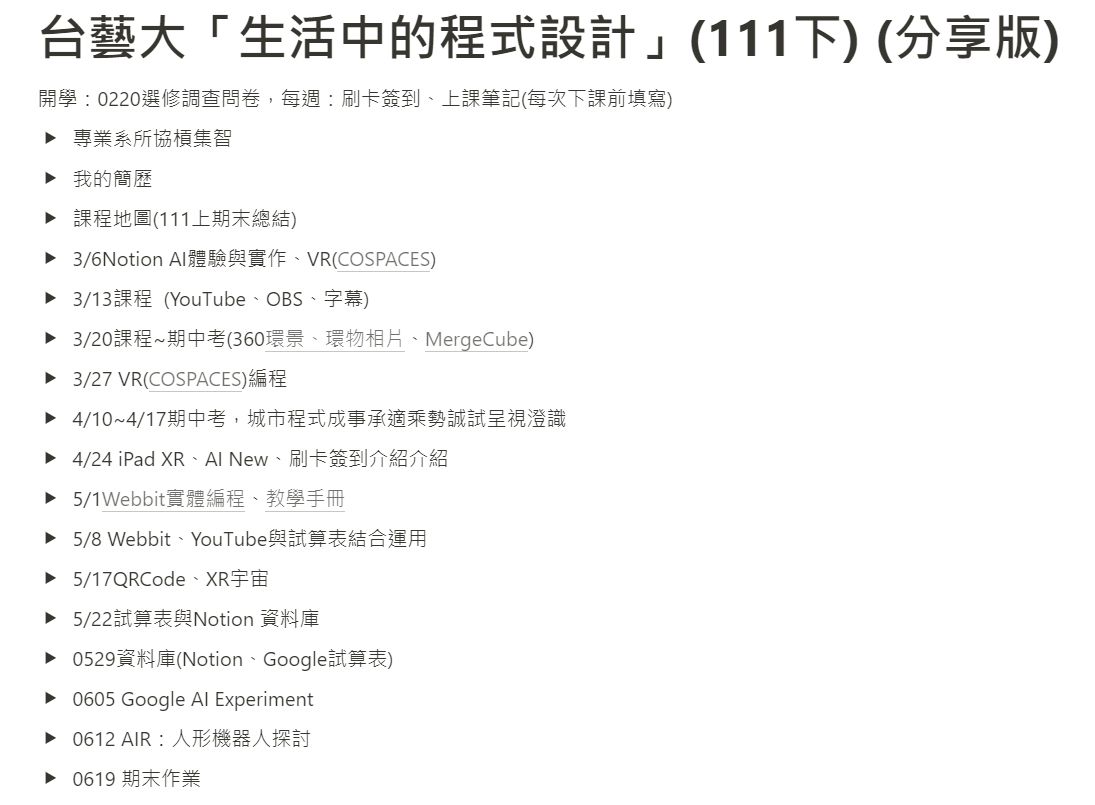

這也是去年的下學期在台藝大上課的規劃,這次加了Padlet。

|  |

起心動念:智慧造境、數位轉型DX、校本活動

◎Notion to Motion

個人資料數位收藏庫與策展區

◎Google PBL

真實世界的數位化集成

個人、人際的數位交互

實體、數位、人際

Digital+Many

◎AIGC

Text to Xmedia

AI生成內容,多元媒體多樣轉換

◎Padlet

最快調動參與者投入數位行為展現

◎Google三寶X IoT、QRCode、NFC

物品(Thing)、任務(Task)、領悟(Think)全貫連

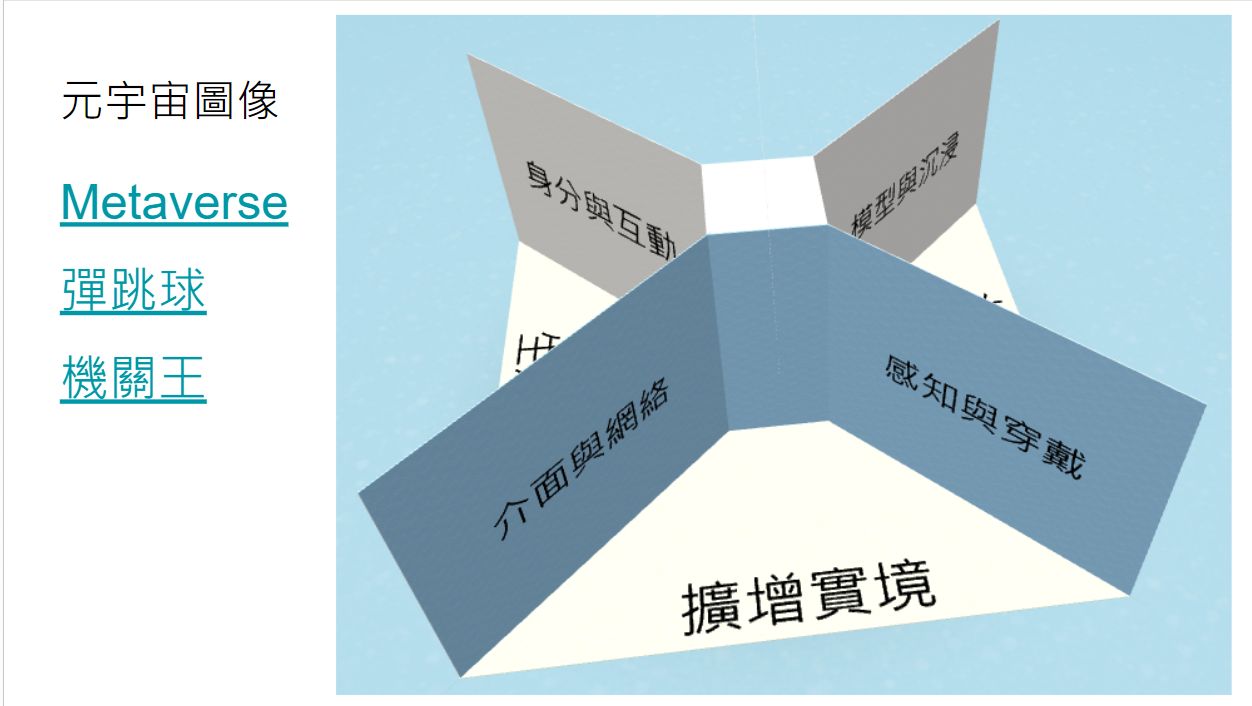

◎原、元宇宙

COSPACES、iPad XR

◎AIRobot(codelab)

AI機器人、機電整合

◎教學平台、課程包

學習吧、奧運

Moodle、因材網

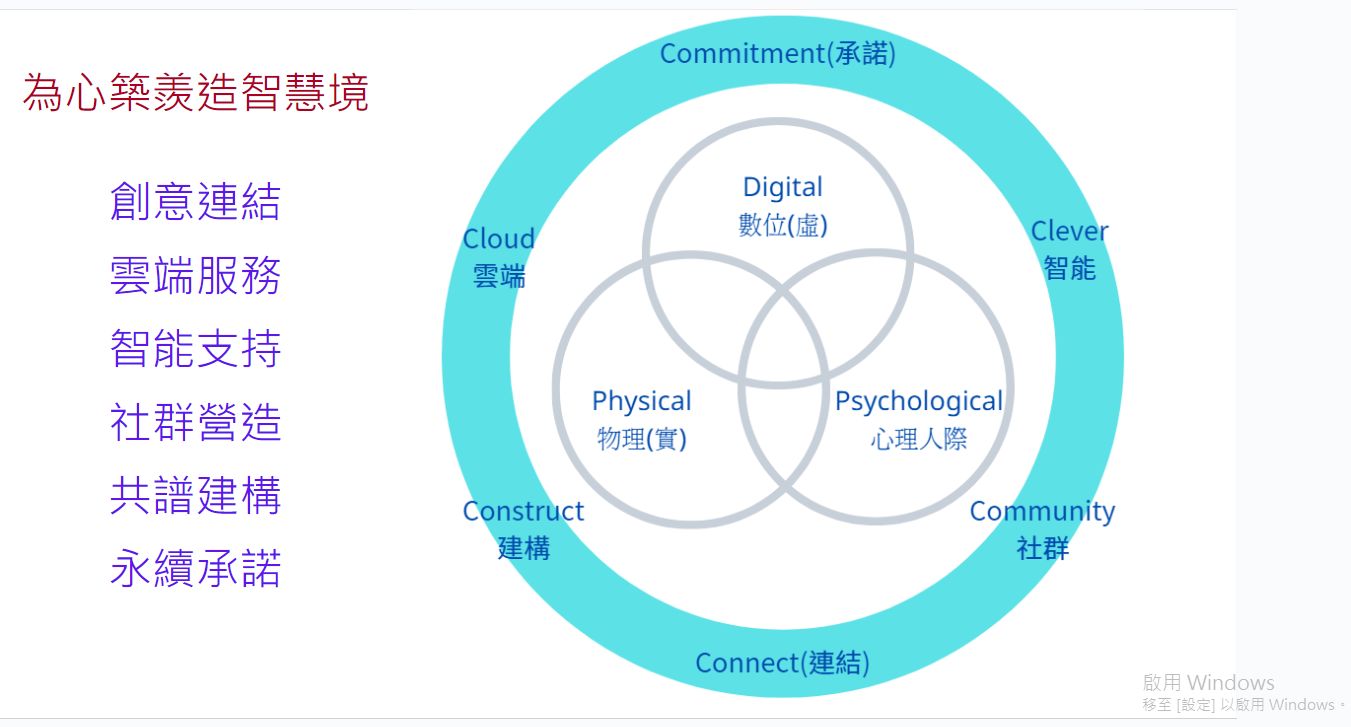

◎為心築羨造智慧境

創意連結

雲端服務

智能支持

社群營造

共譜建構

永續承諾

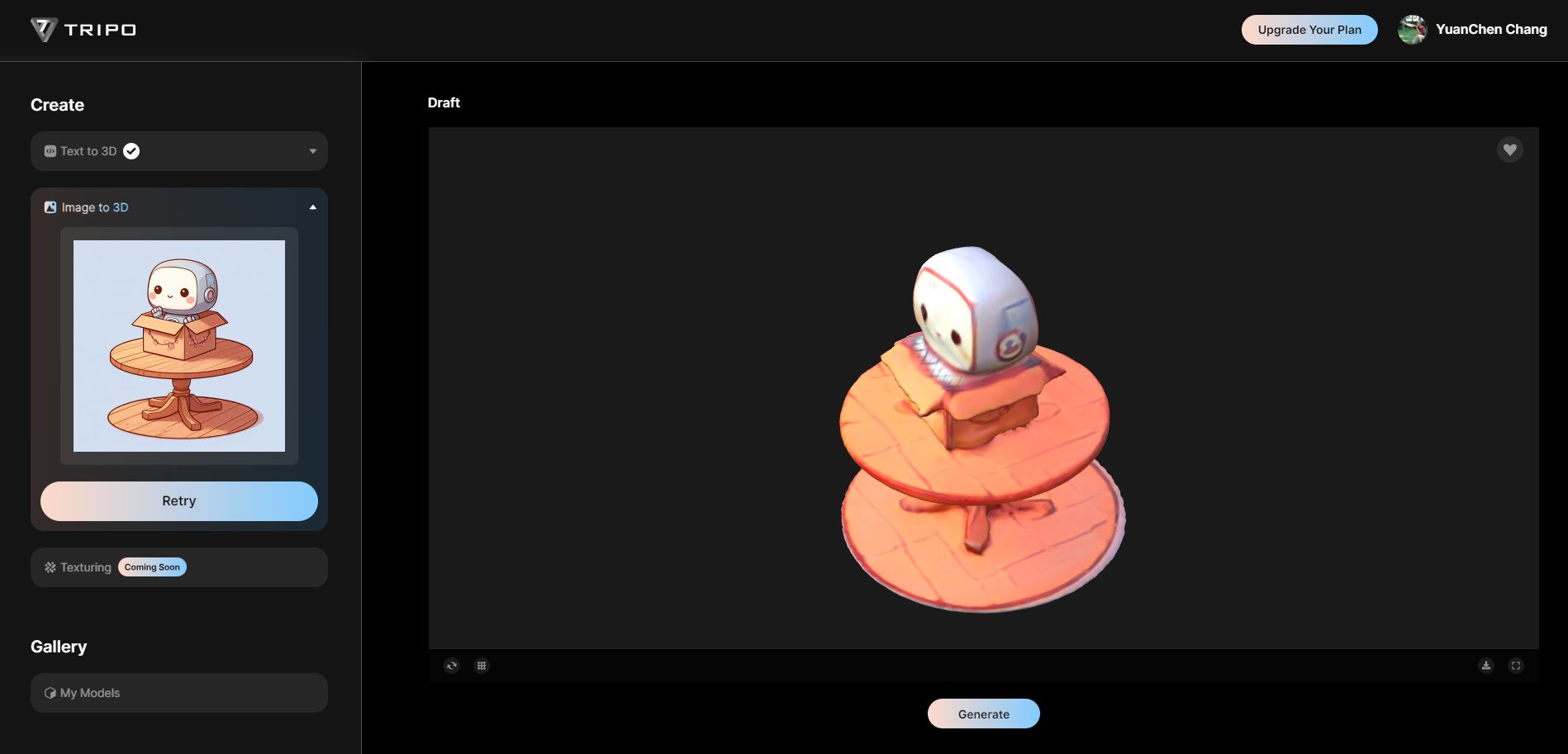

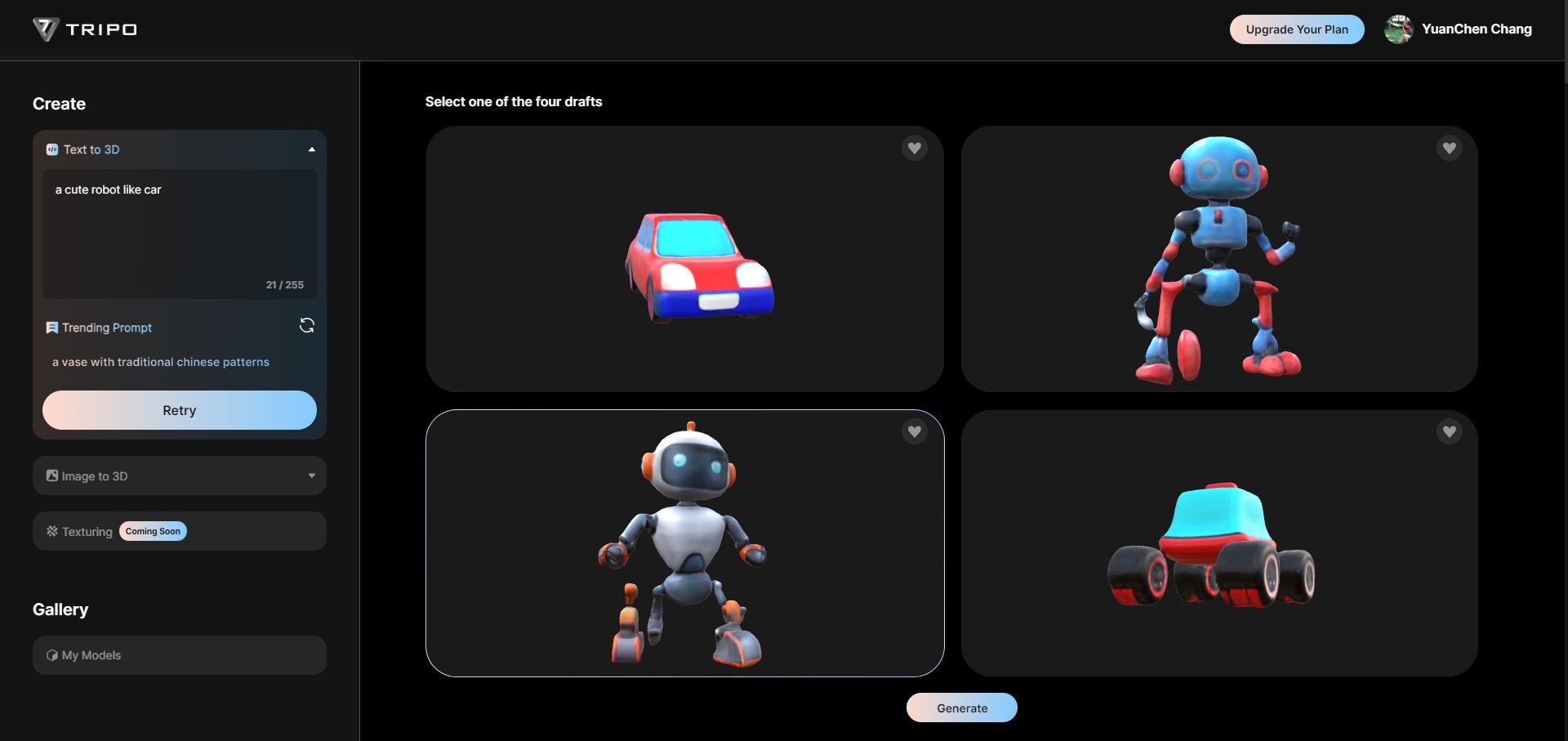

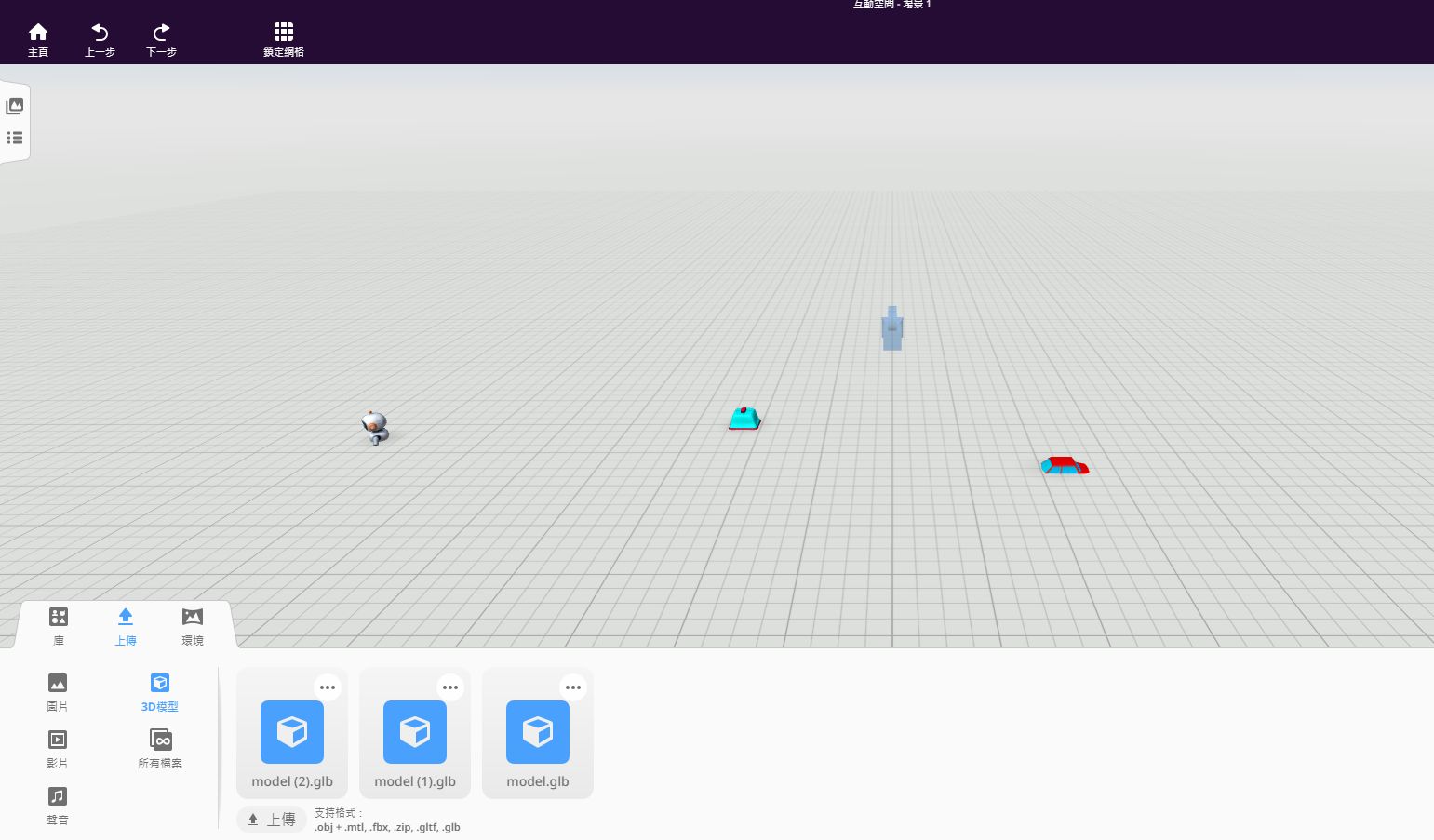

Tripo AI~AI生成3D模型

Tripo AI~AI生成3D模型

作者:塾長 日期:2024-01-06 08:11

「XR 實境教育創意大賞競賽」

「XR 實境教育創意大賞競賽」

作者:塾長 日期:2024-01-05 19:21

剛出爐的「XR 實境教育創意大賞競賽」簡章,迫不及待好好研究。去年初野人獻曝「教育部 112-113 年 5G 新科技學習示範學校計畫徵件申請」發想邀玩,歷經一年來熱鬧精彩見學執行,新年伊始看到比賽徵件,真覺得這時間點超級美妙!

|  |

※活動目的

一、 推展新科技應用在中小學課程與教學,引導學校結合 5G 行動通訊網路為基礎,善用學習載具,結合多元互動教材等進行數位教材創作,如虛擬實境(以下簡稱 VR)、元宇宙等相關互動教材。

二、 建立 5G 運用與多元模式的智慧學習環境與教學示範,引領學生於校園、教室內外線上互動情境之探索學習、體驗學習及沉浸學習,將XR 數位教材融入教學現場。

三、 增進中小學教師運用新科技教學能力,發展新科技教學與學習模式,以符合 5G 教學與學習需求,提高學校師生數位學習教學資源應用與推廣。

四、 融入數位創意表現與設計,應用新媒體 XR(AR/VR/MR)形式創作體驗式娛樂內容,提供新型的解決方案,帶來全新的獨特娛樂體驗。

※說明會時間

主辦單位將在1/10辦理說明會(官網也於到時正式開放),到收件截止(3/15)有兩個月時間,正好跨過寒假與下學期開學後。若這次能共襄盛舉參賽,也等於為新的一年規劃大家共備課程、開發內容與交流應用,有助於校內外師生參與,甚至縣市間的教學交流經營喔!尤其「模式二XR共學中心」的縣市夥伴,也能趁此機會發想未來各種模式中,可能需要的XR內容作品,甚至期待賽後優良作品的延伸應用。

此外,好開心看到這次的競賽項目讓師生都能參與:

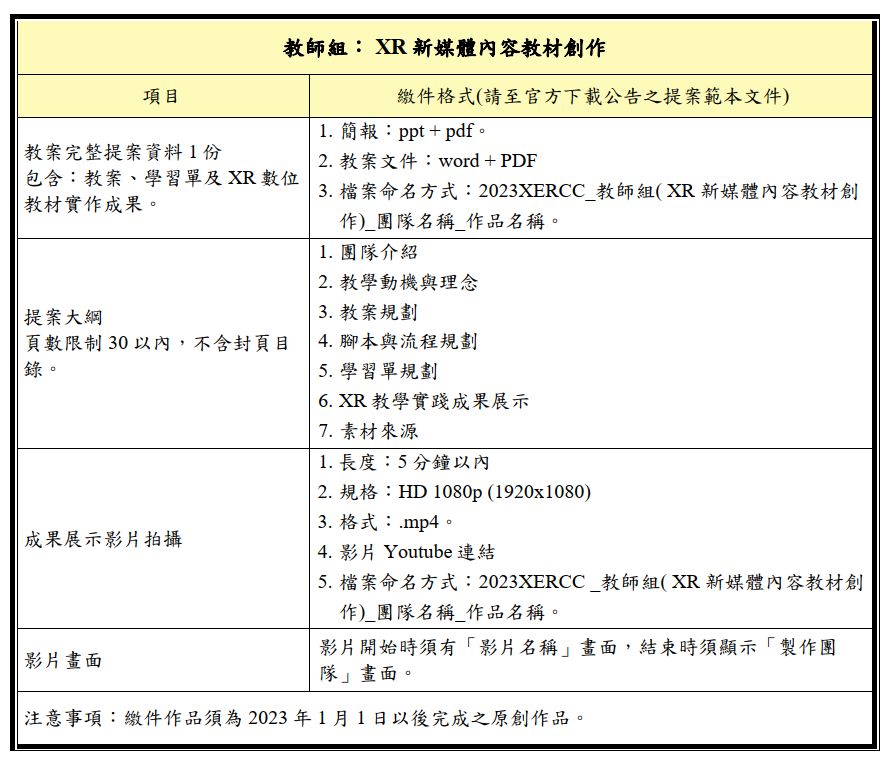

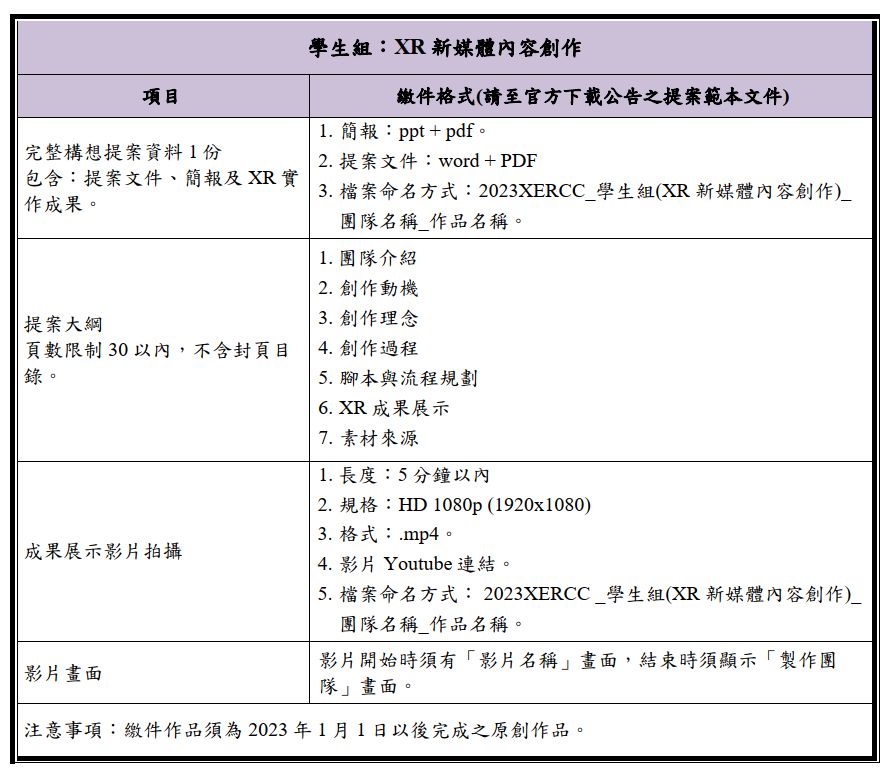

※教師組分為教案設計與教材創作

1. VR 融入教學:運用新科技進行教學融入、具教學實踐與多載具通用為佳。

以教案設計為主,需使用現有VR 教材引用規劃,符合十二年國民基本教

育課程綱要範圍。

|  |

2. XR 新媒體內容教材創作:運用數位工具創作結合與XR 創意內容相關之新媒體內容教材(含AR/VR/MR)。

以創作AR/VR/MR 多樣化類型之數位教材為主,推展專題導向學習(PBL)及5G 新科技學習應用與實踐,以多載具通用為佳。

※學生組涵蓋很廣:全國公私立大專校院及中小學在校學生(含碩博生),國小組僅限高年級(具

正式學生證明)。 參加XR 新媒體內容創作競賽:以創作體驗式娛樂性內容為主,主題包含但不限於解謎互動、遊戲設計、社會議題、商業領域、教育領域等。

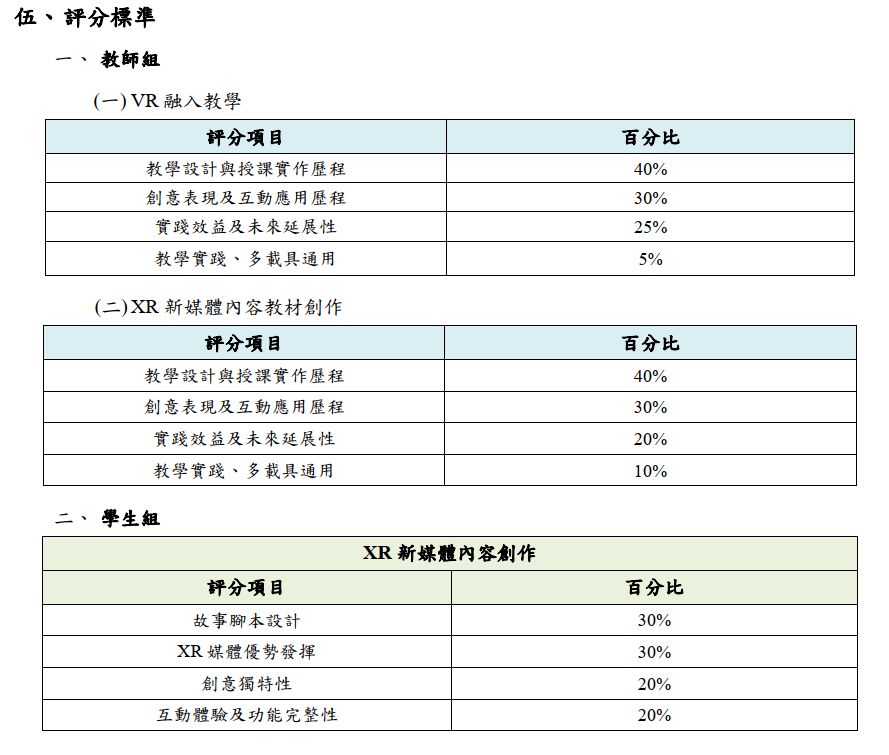

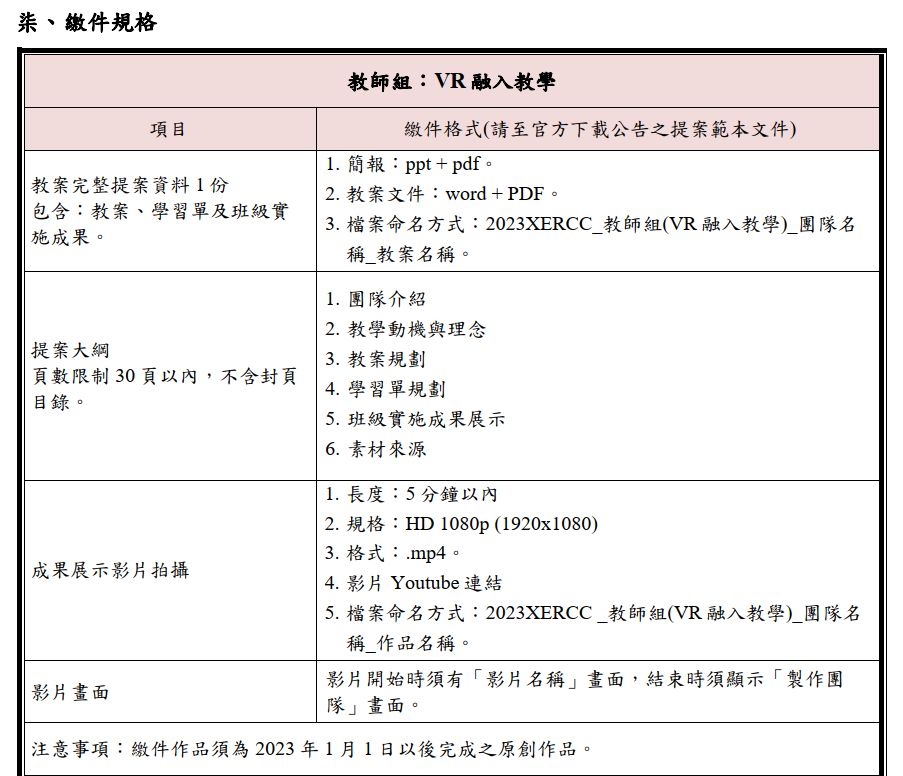

※評分標準與繳件規格

從作品評分標準來看,即參加師生在這次機會裡可以養成與表現的能力。繳件規格所描繪的,就是在過程中持續推進開展的歷程資料。而辦法中也提及「產出之作品應多行動載具應用,於電腦端進行XR 數位內容編輯與創作,輸出後可搭配行動載具進行學習,已完成之XR 數位成果,可應用之平板電腦、VR 頭盔及AR 眼鏡等,可融入多種行動載具之XR 數位內容創建及學習方法。」這樣能在更多教室裡讓師生們享受XR 數位成果,到時的推廣能遍及全國各校各班,更令人期待!

|  |

1.關於教師團隊教案設計

若是原本已執行的教學活動,既有教案、觀議課與錄影資料,可以趁這次機會加以精緻化,不僅可用於期末報告,也能將整體教學成果再檢視、修正來參賽。

而若想設計新的教案,也能在寒假期間發想,開學初實施、拍攝影片整理呈現。

2.師生XR 新媒體內容創作

去年整理的表格中,就有提及:MAKAR、AR2VR、COSPACES、VR-Crevision、Jigspace,都是可以師、生自製XR 新媒體內容的創作編輯工具,當然,也可以運用更專業的工具如Unity、Unreal和相關3D工具平台來開發。

我們自己期許或邀請師生同好們,一起參與這兩個月的創新旅程,大家一起來!就像我去年提到「關於KPI」:基本上還是認真玩真的,自然PDCA起來就有了,這次參賽,等於預約好KPI完成式呢!開心!

ILovePDF網站拆分PDF,發想Mergecube、Jigspace玩XR直播

ILovePDF網站拆分PDF,發想Mergecube、Jigspace玩XR直播

作者:塾長 日期:2023-10-23 15:56

下午利用ILovePDF 網站拆分PDF,發想Mergecube、Jigspace玩XR直播應用玩法。

完全看不懂的韓文,拜Google翻譯之助,想研究這篇「基於元宇宙的未來教育學習環境設計研究」有300多頁,利用Google文件開啟無法一次開成功,大概幾十頁就斷了,我先切分章節來玩。

|  |

|  |

針對Merge Cube (以COSPACES為主)我想了幾個點子,尤其在XR直播可以試試:

1、MC本體優勢:可列印免費,原版(幾百元)軟橡膠也很好

2、新奇:像QRCode,卻是立體,可表現移動、轉動效果,有如實物呈現於環境中

3、威力:可以自製,寫程式。表現重力、彈跳

貼相片或擺放拍攝,可呈現遠近效果、環境效果

另外,我也要玩Jigspace ,現在努力嘗試把真人和模型合拍起來,可以展現玩轉擺弄效果更好!

|  |

以班級導師為例,可以怎麼玩IoT呢?

以班級導師為例,可以怎麼玩IoT呢?

作者:塾長 日期:2023-10-16 10:57

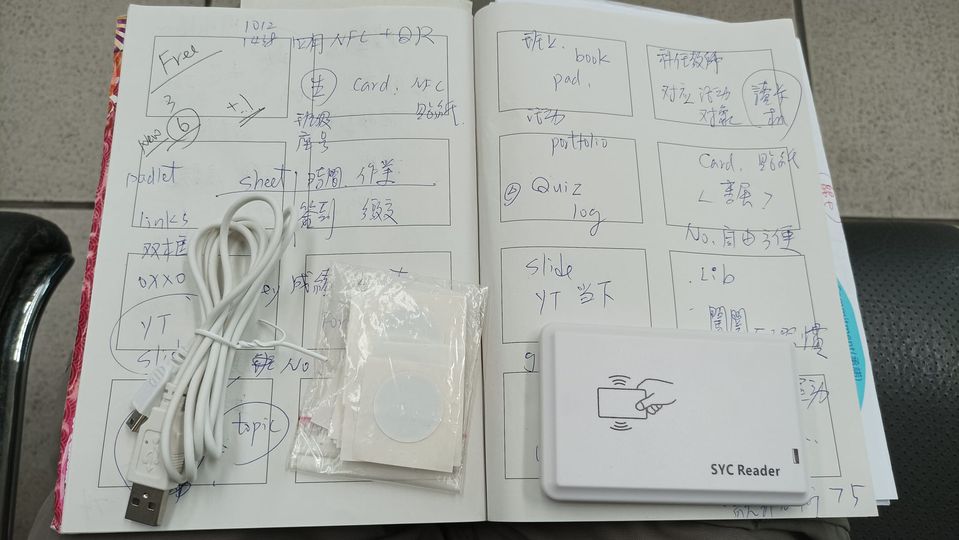

先畫格本玩模擬想像 ,再細看試算表規劃,也回顧IoT智慧教室目標(運用物聯網的智慧教育規劃初探)。

※基礎分析

結合智慧造境的想法,把班級座號、學號、學生證悠遊卡號,建立一個關聯Google 試算表,NFC貼紙每張的號碼也先讀過一次建檔,後續欄位可以結合人員,物品,地點或時間,當然,細一點還可以結合學習活動、知識點,此外,還有QRcode可以玩,呈現內容,觸發活動,個人化支持…,可以邊做邊玩想來迭代推進。

QRcode可以自由生成,使用者自己看讀,也能結合物聯網串連,自學看跟全班控播看都可以。

我想到的自由串玩:人在卡在,貼紙與讀卡機自由出沒,由老師設計主導,QR Code自由發揮,做,貼,使用,讀取端可以利用電腦視訊鏡頭,手機、平板,WebAI車。

資料積累

在試算表方面,除了建立班級座號、卡號跟對應貼紙號碼之外,可以考慮這些數字是針對人,針對活動、也可以是一號一卡,也能可以多用途設計(如不同頻道與訊息,在觸發當下一魚多吃)。在試算表的紀錄應用上,譬如簽到退時間,作業繳交與否,還有輸入成績,可以輸入班級座號,就輸入成績到每個學生對應的欄位、全班的表格,或者是個人的表格分頁,班級座號的成績甚至可以成為個人試算表的分頁名稱,或者把班級座號、卡號來當作物聯網頻道、訊息的方式來發送。當然,同樣的概念在QRcode 也通,甚至組合混搭更好!

※教學經營

在班上環境的活動運用,教室或校園裡有座位、書本、平板,教具與學具,海報與佈置。活動的部分,能夠留下個人、小組跟全班的歷程資訊,作答的紀錄。

在Google簡報跟YouTube影片,利用之前的程式,可以自看與控播,可以寫筆記、試題作答,也可以交由孩子們自己設計創新應用,值得期待!

還有還有,這樣的班級…以後我還可以遠距亂入一起玩呢,呵呵!

|  |

今天起到周末,要來完成(玩呈)「造智慧境玩ePBL」!(細看試算表規劃)

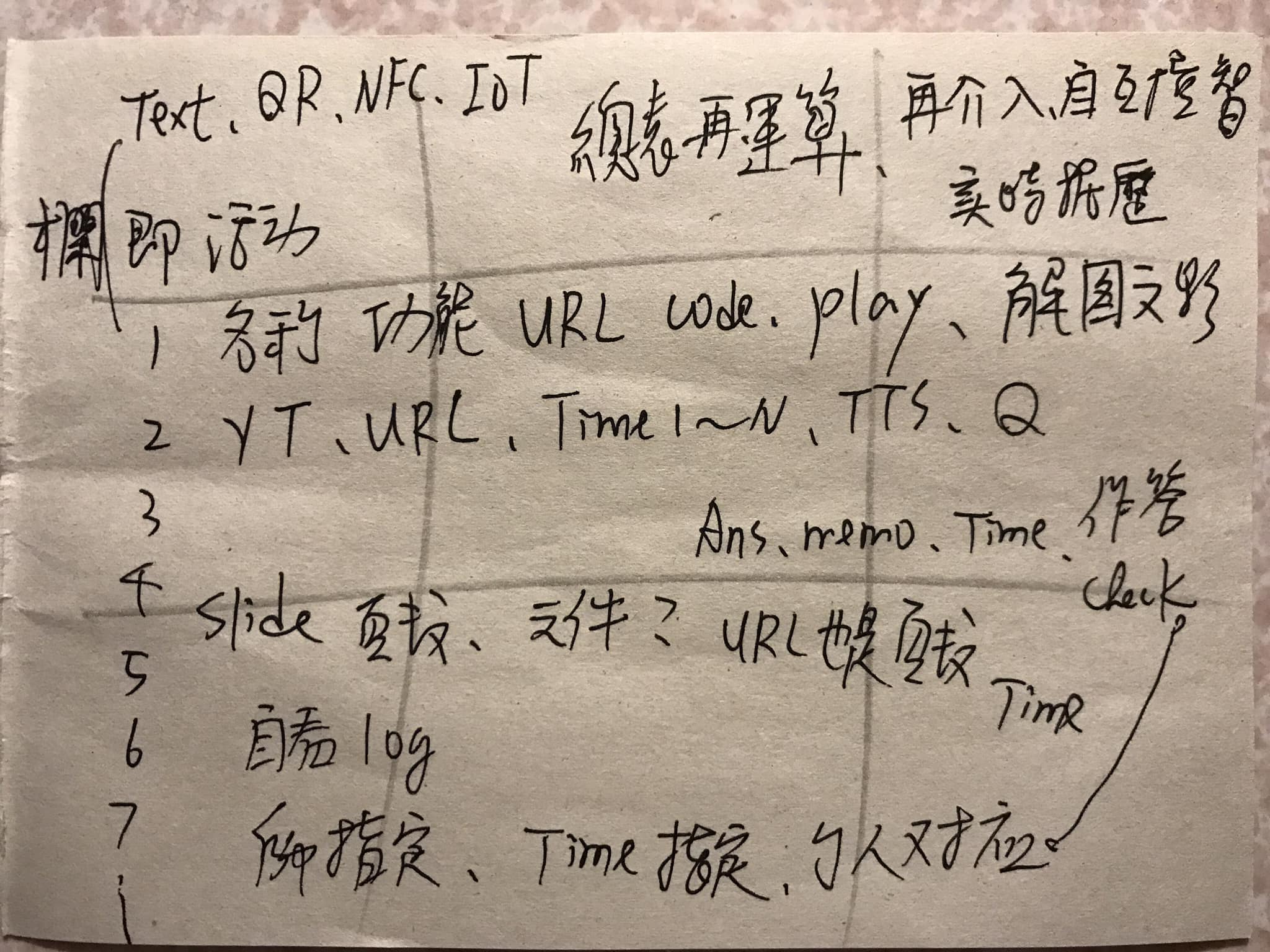

一筆資料就是一個活動。

從編號開始,編號可以是文字、QR Code、NFC,物聯網的訊息甚至頻道。

有名稱,功能說明,這個活動要做什麼。有超連結:包括程式碼、播放網頁(教師與學生雙版)、萬用遙控器、解釋的圖文影音。

YouTube影片,超連結、時間,可以多段標註,夠有TTS文字說明語音。有提問,這是老師事先準備好,或即時輸入鍵檔皆可。

資料寫入,主要有學生的個人登錄,看影片寫筆記,以及答題結果、作答時間跟作答正確與否的檢核,希望可以應用亂數出題,還能將全套題庫答完。

Google 簡報,是超連結、頁數,各頁的多媒體組合元件也可以是超連結,甚至是頁數樹之間轉換。

當然還包括學習者切換看各頁的時間,和老師指定頁面的設計,針對內容是什麼以及作答的回應又是哪些,都能依需設計,如實紀錄。

還希望這個總表的大數據,還能再利用,老師可以在運算後再介入,達到自動、互動、控動與智能支持的機會。讓一節課的全貌,都能在師生互動中,將真實發生的事物歷程加以記錄與建成數據、再利用。